Bisherige "continuous response" - Systeme

Der folgende Text stammt aus der Bachelorarbeit von Carolin Scholle: Vom Drehschalter zum Multitouch. Das iPad als musikpsychologisches Forschungsinterface, Osnabrück 2012.

Bestehende Interfaces zum zweidimensionalen Emotionsraum

Nachdem Russel 1980 sein Circumplex Model of Affect vorgestellt hatte, dauerte es noch lange, bis dies in einem digitalen Interface verwendet wurde. Mitte der 90er Jahre wurde mit dem EmotionSpace Lab die erste Variante eines zweidimensionalen Emotionsraums (2DES) auf dem Computerbildschirm entwickelt. Seitdem sind eine Reihe von Verbesserungen und Varianten in Umlauf gekommen, die aufgrund der technischen Entwicklung deutlich leistungsfähiger sind. Dieses Kapitel stellt die einzelnen bestehenden Interfaces vor und stützt sich dabei im Wesentlichen auf die Zusammenfassung von Kopiez et al. (2011).

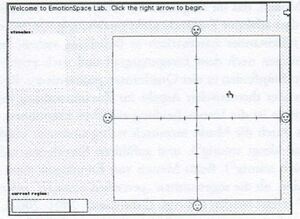

EmotionSpace Lab

Das EmotionSpace Lab (ESL) wurde 1996 von dem australischen Musikpsychologen Emery Schubert entwickelt und ist das erste Programm, das den 2DES verwendet. Die Steuerung funktioniert mit der Maus. Smileys zur Verdeutlichung sind jeweils an den Enden der Achsen vorhanden und visuelle Stimuli können neben dem Emotionsraum gezeigt werden. Zusätzlich zum Cursor wird, wie in Abbildung 3.1 zu sehen ist, unten links die horizontale Position visualisiert. Die Achsen sind gleichskaliert, die Valenz wird horizontal angegeben, die Aktivität vertikal. Als Stimuli sind neben Audiodateien Wörter und Bilder möglich, die neben dem 2DES angezeigt werden (Kopiez et al. 2011, S. 132f.). Das ESL verwendet eine Sample-Rate von 2 Hz, also zwei Samples pro Sekunde. Dies wurde damit begründet, dass die Veränderungen in der Aktivitätseinschätzung als Reaktion auf Lautstärkeveränderungen erst 1-3 Sekunden nach dem akustischen Ereignis auftraten. Nach dem Nyquist-Shannonschen Abtasttheorem (Benson 2007, S. 254f.) muss die Sample-Rate mind. doppelt so hoch sein wie die zu erwartende Frequenz des Signals, also zwei Samples pro Sekunde um sekundengenau auswerten zu können (Schubert 2010, S. 225).

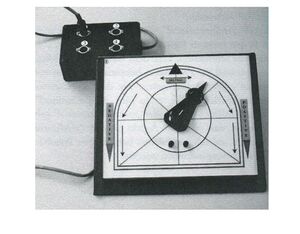

Das zweidimensionale CRDI

Das Continuous Response Digital Interface (CRDI) wurde Ende der 1980er Jahre entwickelt und ermöglicht Angaben zu Musik anhand einer Dimension. Es gibt die Variante als Zeigerscheibe, wie sie in Abbildung 3.2 zu sehen ist – der Drehschalter am Anfang der Entwicklung digitaler Interfaces zur Erfassung von Emotionen – oder als Kästchen mit einem Hebel oder Schieberegler. Sollen mit dem CRDI zweidimensionale Daten erhoben werden, besteht die Möglichkeit, zwei Geräte simultan zu verwenden (Kopiez et al. 2011, S. 73-77). Das von Madsen 1997 und 1998 verwendete zweidimensionale CRDI funktioniert ähnlich wie das ESL indem es auf einem Computerbildschirm zwei Dimensionen gleichzeitig darstellt (Kopiez et al. 2011, S. 134f.).

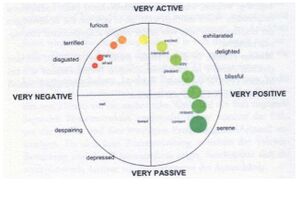

Feeltrace

Das Feeltrace beschränkt den bisher immer rechteckigen 2DES auf eine Kreisfläche. Es werden um den Kreis herum diverse Emotionen angeordnet, wie z. B. furious, delighted etc. Stimuli und Emotionsraum werden hier nicht innerhalb eines Programmes präsentiert. Die Steuerung erolgt wie gewohnt mit der Maus. Zusätzlich bietet dieses Interface ein Userfeedback, in dem nicht nur ein Cursor visualisiert wird, sondern an der aktuellen Mausposition ein Kreis angezeigt wird, dessen Farbe abhängig ist von der Position im System. Für positive Valenz wird er grün, für negative rot, hohe Aktivität gelb und niedrige blau eingefärbt. Zwischen den äußersten Punkten an den Achsenenden, wo diese Farben jeweils rein auftreten, werden Mischfarben gebildet. Zusätzlich zu den Farben gibt es ein zeitliches Feedback dadurch, dass die vorherigen Mauspositionen als Kreise bestehen bleiben, nach und nach kleiner werden und schließlich verschwinden. Es entsteht der Eindruck eines sich bewegenden Wurms – ein Konzept, das die später entwickelten Interfaces übernehmen (Kopiez et al. 2011, S. 136-138).

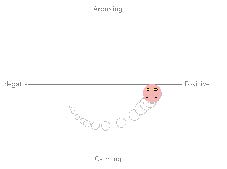

EMuJoy

EMuJoy ist die Abkürzung für das Interface Emotion measurement while listening to Music using a Joystick. Die Software wurde 2007 von Frederik Nagel entwickelt und ist eine Weiterentwicklung des ESL. EMuJoy bietet die Möglichkeit, sowohl akustische, als auch visuelle Stimuli oder beides gleichzeitig zu verwenden. Bilder können in einer Slideshow mit je einer bestimmten Zeit, mit oder ohne Pausen dazwischen gezeigt werden. Bei Filmen können Bild und Ton auch getrennt gezeigt werden (Nagel 2007, S. 35f.). Der 2DES nimmt den gesamten Bildschirm ein, kann mit Joystick oder Maus bedient werden und bietet als optionale Visualisierung einen Wurm wie das Feeltrace. Statt der Visualisierung mit Farben gibt hier ein an Stelle des Mauszeigers befindlicher Smiley, der seinen Gesichtsausdruck der Position im Koordinatensystem anpasst, Userfeedback. Entlang der Valenz-Achse verändert sich der Mundwinkel und die Augengröße steigt mit zunehmender Aktivität. Per Mausklick werden zusätzlich Chills erfasst (Kopiez et al. 2011, S. 138-141). Weitere Vorteile von EMuJoy gegenüber den Vorgängern sind Plattformunabhängigkeit, da das Programm auf Java-Basis läuft, und Steuerung via Internet, sodass die Testpersonen zu Hause vor ihrem eigenen Computer an Untersuchunngen teilnehmen können. Außerdem gibt es eine Remote-Steuerung, sodass Starten, Stoppen sowie Aussuchen der Stimuli während des Versuchsverlaufs ermöglicht wird (Nagel 2007, S. 33f.). Nagel verwendet eine Sampling-Rate von 1/50ms, sodass die Daten bis 10 Hz ausgewertet werden können. Eine hohe Sampling-Rate ist vorteilhaft für die Synchronisation von Stimulus und den aufgezeichneten Daten. Man könnte meinen, da sich Emotionen weit langsamer ändern, sei eine so hohe Abtastrate unnötig, aber dennoch können die Selbstauskünfte sich sehr schnell ändern und man könnte wertvolle Daten verlieren, z. B. den schnellen Weg von der einen zur anderen Ecke (Nagel 2007, S. 32f.).

RTCRR

Bei dem Real Time Cognitive Response Recording (RTCRR, „Arti-car“) handelt es sich um Schuberts eigene Weiterentwicklung des ESL, die aber komplett neu programmiert wurde, um unter MAC OS X 10 einsetzbar zu werden. Das Interface ist sehr auf Flexibilität hin angelegt und sowohl für die optische Darstellung als auch für den Export der Ergebnisse gibt es viele Einstellungen. Es bietet die Option, eine oder beide Achsen zu verwenden, die Achsen mit verschiedenen Begriffen zu beschriften (siehe Abbildung 3.6) und darüber hinaus eine Verbesserung der Sample- Rate und des Ausgabe-Formates. Die Position im 2DES wird entlang der Achsen mit zwei Schiebereglern angezeigt, der Mauszeiger optional mit dem gebräuchlichen Wurm in variabler Länge visualisiert. Als Stimuli kommen alle von Quicktime unterstützen Audio- und Multimediaformate in Frage. Dabei werden Filme links oben in der Ecke des „Question“-Fensters angezeigt. Nach der Messung, bei der Daten in einem internen Format gespeichert werden, kann in gewünschter Sample- Rate zwischen 1 und 30 Hz exportiert werden, sodass ein für ein Statistikprogramm nach Wahl verwertbares Ausgabeformat wie in Abbildung 3.8 entsteht. Allerdings war die maximale Sample-Rate von 30 Hz, als die Beta-Version 2007 erschien, ein eher theoretischer Wert, der durch Leistung des Computers und Verwendung der Feedback-Optionen, vor allem des Wurmes, stark eingeschränkt wurde. Es wird erklärt, wie man anhand eines Testlaufs herausfinden kann, welche ungefähre maximale Abtastrate zu erreichen ist (Schubert 2012). Dies deutet darauf hin, dass das Programm intern die Daten eventbasiert erhebt und nicht im Abstand eines bestimmten Zeitintervalls die Position der Maus ausliest.

pARF

Die Portable Audience Response Facility wurde entwickelt, um während einer Aufführung Reaktionen des Publikums aufzuzeichnen. Es funktioniert ein- oder zweidimensional und wird bedient mit einem Stift und Touch Screen. Pro Quadrant wird eine Emotion angezeigt: angry, joyous, depressed und peaceful. Es wurde in zeitgenössischen Tanzaufführungen verwendet (Kopiez et al. 2011, S.147-148). Die Ergebnisse werden dabei mit einem Zeitstempel versehen und können so synchronisiert werden. Es besteht keine Möglichkeit, Stimuli über das Gerät selbst wiederzugeben (Stevens, Vincs und Schubert 2009).

Vergleich der Interfaces

Die Interfaces haben das gemeinsame Ziel, Emotionen in Echtzeit von Testpersonen angeben zu lassen und die Ergebnisse mit einem bestimmten Stimulus synchronisieren zu können. Unterschiede zwischen den Interfaces sind einige Funktionen und die Oberfläche. Nach Kopiez et al. ist das Verstehen des 2DES für die Probanden kein großes Problem, es muss nur einen kurzen Vorlauf geben, um zu üben, sich einzuordnen. Allgemein wird bei dieser Art der Erhebung wenig Verbalisierungsfähigkeit der Versuchspersonen erfordert. Die Autoren kommen zu dem Ergebnis, dass EMuJoy die derzeit beste Softwareumsetzung ist. Wichtige Argumente dafür sind die Plattformunabhängigkeit (z.B. ESL/RTCRR nur auf Mac-Systemen), hohe Sampling-Rate und Flexibilität bezügl. der Stimuli, die nicht einmal zwangsläufig vor Beginn des Experiments ausgewählt werden müssen, sondern auch an Reaktionen des Probanden angepasst werden können. Es ist insofern intuitiv, dass es den gesamten Bildschirm einnimmt und die Stimuli im Hintergrund des Koordinatenkreuzes eingeblendet werden. Allerdings könnten Smiley und Wurm ablenken bzw. Bildausschnitte verdecken. Das RTCRR wird ebenfalls als positiv bewertet, hat aber den Nachteil, dass pro Stimulus das Programm kopiert werden muss, damit eine verwertbare Ausgabedatei entsteht. Im Gegensatz zu EMuJoy verfügt es aber im Untersuchungsfenster über einen Play-Button, sodass der Proband den Stimulus selbst starten kann und ihm somit von Beginn an volle Aufmerksamkeit widmet (Kopiez et al. 2011, S. 149-152). Diesem Fazit ist soweit zuzustimmen. EMuJoy scheint dem im gleichen Jahr entwickelten RTCRR überlegen zu sein, alle anderen Interfaces entsprechen nicht mehr dem aktuellen technischen Entwicklungsstand. Dabei profiliert sich EMuJoy vor allem über die intuitivere Visualisierung. Man vergleiche beispielsweise den Feedback-Wurm auf den jeweiligen Screenshots (siehe Abbildung 3.4 und Abbildung 3.7). pARF setzt sich durch die mobile Einsatzmöglichkeit ab, bietet aber eine schlechtere visuelle Erscheinung und kann keine Musik wiedergeben.

Runder und rechteckiger Emotionsraum

Neben der Betrachtung von unabhängigen Valenz- und Aktivierungswerten lässt der zweidimensionale Emotionsraum es zu, den Abstand des Punktes vom Koordinatenursprung als Emotionsintensität zu interpretieren. Kopiez et al. (2011) bezeichnen die Emotionsintensität als Dimension und sowohl die Auswertung der Koordinaten anhand ihrer x- und y-Komponente als auch der Richtung (des Winkels) als Analyse von Emotionsqualität. Diese Bezeichnungen scheinen unglücklich gewählt zu sein, da der Abstand vom Koordinatenursprung keine dritte, unabhängige Dimension ist, sondern lediglich eine Umdeutung vorliegt. Ein Punkt im Koordinatensystem wird dabei durch Polarkoordinatenform festgelegt, also durch die beiden „Dimensionen“ Abstand zum Ursprung (Emotionsintensität) und Winkel zwischen der Verbindungslinie des Punktes mit dem Ursprung und der x-Achse (Emotionsqualität). Eine Analyse von x- und y-Koordinaten sollte ebenfalls sowohl qualitative (z. B. Verhältnis x- und y-Wert) als auch quantitative Auswertung (z. B. anhand der einzelnen Dimensionen) ermöglichen. Eine Untersuchung der beiden einzelnen Komponenten ist durchaus üblich und bezieht sich auf Quantität, nicht nur Qualität (vgl. Kapitel 4). Je nach dem, welche der beiden Interpretationsweisen Schwerpunkt der Auswertung sein soll, sollte das Interface gewählt werden. Möchte man die Daten aus einer Versuchsreihe mit dem 2DES gerne im Hinblick auf Emotionsintensitäten interpretieren, bietet die Einschränkung auf den Kreis wie beim Feeltrace Vorteile. Bei einem rechteckigen Modell können für verschiedene Winkel unterschiedliche maximale Intensitäten angegeben werden, da beispielsweise die rechte obere Ecke weiter vom Ursprung entfernt ist, als der äußerste Punkt auf der x-Achse am rechten Bildschirmrand. Man müsste entscheiden, ob man mit absoluten Abständen zum Ursprung oder relativen Abständen in Bezug auf den maximal möglichen Abstand unter einem bestimmten Winkel mit der x-Achse rechnen möchte (vgl. Kopiez et al. 2011, S. 153f.). Umgekehrt ergibt sich beim kreisförmigen Emotionsraum eine Problematik bei der Auswertung der Einzelkomponenten Valenz oder Aktivität: Kann eine positive Emotion weniger Erregtheit beinhalten als eine im Bezug auf Valenz neutrale?

Steuerung

Die vorgestellten Interfaces verwenden als mögliche Eingabegeräte Computermaus, Joystick oder einen Stift in Verbindung mit einem Touchscreen. Die Steuerung mit einem Joystick bietet zwei Möglichkeiten: Bei Nagel gibt die Joystickposition die Zeigerposition im 2DES an, wobei ausgenutzt wird, dass man sich automatischer in den Nullpunkt zurück bewegt. Möglich ist es auch, dass die Joystickposition der Bewegungsgeschwindigkeit und Richtung oder der Beschleunigung entspricht. Bewegt man den Joystick also zum Nullpunkt hin, bleibt der Zeiger, wo er ist und wandert nicht ebenfalls in den Nullpunkt (Kopiez et al. 2011, S. 154f.). Ob Maus oder Joystick besser vermittelt zwischen Testperson, ihrer gewünschten Position und dem Weg dahin, hängt sicher auch mit der persönlichen Erfahrung mit dem einen oder anderen Eingabegerät zusammen. Wer noch nie einen Joystick benutzt hat, kommt vielleicht besser mit der Maus zurecht, auch wenn der Joystick möglicherweise intuitiver bedient werden kann. Die Verwendung eines Touchscreens allerdings macht es möglich, komplett auf diese Vermittlung zu verzichten und direkt im Bild den Punkt auszuwählen. Gerade bei Versuchspersonen, die den Umgang mit Computern weniger gewohnt sind, kann dies helfen, die Barriere des Interfaces zu reduzieren und ein Stück weit verfälschten Ergebnissen vorzubeugen. Dem pARF könnte ein Interface für das iPad insofern überlegen sein, dass der Touchscreen groß genug ist, keinen Stift mehr als Hilfsmittel zu benötigen.

Ausgabeformate

Als Zwischenfazit stellen Kopiez et al. fest, dass die Verwendung zweier Dimensionen zur Emotionserfassung universell als sinnvoll empfunden wird, allerdings die einzelnen Modelle durch ihre feinen Unterschiede keinen Vergleich der mit ihnen erhobenen Daten ermöglichen (Kopiez et al. 2011, S. 155f.). Auch die Ausgabedateien sind nicht direkt vergleichbar, allerdings fehlen genaue Angaben zu den Formaten.

Quellen

- Scholle, Carolin (2012). Vom Drehschalter zum Multitouch. Das iPad als musikpsychologisches Forschungsinterface. Bachelorthesis University of Osnabrück.

- Kopiez, Reinhard, Jessika Dressel, Marco Lehmann und Friedrich Platz (2011). Vom Sentographen zur Gänsehautkamera: Entwicklungsgeschichte und Systematik elektronischer Interfaces in der Musikpsychologie. Tectum-Verl.

- Benson, David J. (2007). Music: A Mathematical Offering. Cambridge University Press.

- Schubert, Emery (2010). „Continuous self-report methods“. In: Handbook of Music and Emotion. Hrsg. von Patrik N. Juslin und John A. Sloboda. Oxford University Press. Kap. 9, S. 223–253.

- Nagel, Frederik (2007). „Psychoacoustical and Psychophysiological Correlates of the Emotional Impact and the Perception of Music“. Diss. Hannover University of Music und Drama.

- Schubert, Emery. Real Time Cognitive Response Recording. url: http://marcs.uws.edu.au/links/ICoMusic/ArchiveCD/Full_Paper_PDF/Schubert_2.pdf (besucht am 29. 10. 2012).

- Stevens, Catherine, Kim Vincs und Emery Schubert (2009). „Measuring audience response on-line: an evaluation of the portable audience response facility (pARF)“. In: The Second International Conference on Music Communication Science.